UK : la police veut utiliser lIA pour empêcher les crimes violents avant quils ne se produisent

Comme dans le film Minority Report

La complexification de la nature des crimes au cours de ces dernières décennies rendent moins opérationnelles les méthodes traditionnelles utilisées par la police pour interpeller les acteurs malveillants. Pour adapter ses moyens au changement, la police, dans le monde entier, a de plus en plus recours à lintelligence artificielle et aux données pour prévenir des actes criminels ou arrêter des personnes susceptibles de commettre un crime.

En Chine, la police sest servie de la technologie de reconnaissance faciale pour arrêter un fugitif, recherché pour des crimes économiques non spécifiés, dans une foule de cinquante à soixante mille personnes qui assistaient à un concert de musique pop. La Chine utilise également le big data pour procéder à des arrestations préventives dans la région du Xinjiang. Cette application de lIA a, par ailleurs, été décriée par l'association Human Rights Watch. En Espagne, selon une déclaration de luniversité Cardiff, grâce à une combinaison d'analyse automatique de texte et de techniques d'apprentissage automatique avancées dans un outil mis au point par les experts de Madrid et de Cardiff, la police a été en mesure d'identifier avec succès les fausses déclarations de vol avec un taux de précision de plus de 80 %.

Selon un article de The Independent publié en juin dernier, la police de Londres était en train de tester une technologie de reconnaissance faciale pour appréhender des suspects. Selon une nouvelle révélation de New Scientist, la police britannique veut dorénavant procéder à des interventions préventives au lieu de procéder à lidentification des suspects après que les crimes aient déjà eu lieu, en utilisant lIntelligence. Alors quil ny a pas encore lunanimité sur lutilisation éthique de lIA, les applications se multiplient dans les entreprises comme dans les administrations publiques.

La police britannique veut empêcher les graves crimes violents avant quils ne se produisent en utilisant un système basé sur lintelligence artificielle. Le système baptisé solution nationale danalyse de données (NDAS) est basé sur une combinaison d'IA et de statistiques afin dévaluer le risque quune personne commette ou soit victime dun crime commis avec une arme à feu ou un couteau. Il permet également de détecter si une personne est victime de lesclavage moderne.

Le système fonctionnera à limage du film américain de science fiction Minority Report réalisé en 2002 et qui se déroule principalement à Washington DC et dans le nord de la Virginie en 2054 où un service de police spécialisé nommé PreCrime, appréhende des criminels en se fondant sur la connaissance anticipée fournie par trois voyants appelés « précogs ». Plusieurs meurtriers ont été arrêtés réduisant le taux de meurtres à zéro, en 2054.

Selon New Scientist, les forces armées rechercheraient un système capable de pendre en charge les personnes ayant déjà un antécédent avec les forces de lordre, face à une réduction considérable du financement de la police. Cependant, les personnes signalées par la NDAS ne seront pas préventivement arrêter, mais devront plutôt bénéficier de lassistance des travailleurs de santé et sociaux qui pourront donner des conseils à des celles ayant des antécédents de problèmes de santé mentale identifiées par la NDAS comme susceptibles de commettre un crime violent. Les potentielles victimes pourront également être contactées par les services sociaux.

Lapprentissage automatique de la NDAS

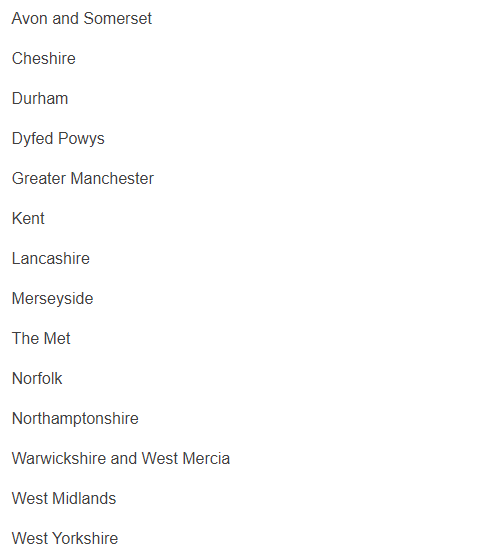

Selon New Scientist qui est informé du système, léquipe en charge du projet piloté par la police de West Midlands a amassé plus dun tétraoctet de données denviron 5 millions dindividus identifiés dans les bases de données de la police nationale, spécifiquement des enregistrements des personnes interpellées et des registres des crimes commis.

Pour construire son modèle dIA, le système a analysé lensemble des données recueillies et a détecter que près de 1 400 indicateurs pouvaient aider à prévoir la criminalité qui permettront à la NDAS de prédire quelles personnes connues de la police et ne présentant pas encore de signes intenses dactivité malveillantes peuvent suivre une trajectoire de violence similaire à celle observée dans les affaires précédentes.

Les critiques à lencontre du projet NDAS

Selon Iain Donnelly, responsable de la police et conductrice du projet, cest un projet majeur, premier de son genre au monde qui réuni plusieurs ensembles de données provenant d'un certain nombre de forces de police pour la prévision de la criminalité. Cependant, certains aspects du projet ne font pas lunanimité. New Scientist a pu voir le rapport dune équipe de lInstitut Alan Turing de Londres qui a examiné une version rédigée de la proposition NDAS lan dernier. Selon le rapport qui sera publié cette semaine, léquipe de lInstitut Alan Turing aurait relevé « de graves problèmes éthiques » avec le projet NDAS et se demanderait s'il ne serait pas mieux de prévenir un crime avant quil ne soit commis que de surveiller des personnes ayant déjà un antécédent de crime de commettre à nouveau dautres crimes à lavenir.

Selon les chercheurs, la proposition de la NDAS, bien que globalement bien intentionnée sur le plan éthique, ne prend pas en compte tous les problèmes et risque, par ailleurs, de souffrir des prédictions inexactes. Selon un autre chercheur de lUniversité du District de Columbia, les modèles dapprentissage automatique étant formés sur les données des arrestations antérieures, le système pourrait limiter les enquêtes de la police aux lieux fréquentés tout en renforçant les préjugés. Par ailleurs, Martin Innes, directeur du Crime and Security Research à lInstitute de lUniversité de Cardiff, au Royaume-Uni, pense que le projet NDAS serait mieux adapté à la localisation des communautés à risque au lieu dêtre un outil fiable de détection des infractions au niveau individuel.

A cause de toutes ces préoccupations, léquipe projet, sous recommandations de la police de West Midlands, sera emmenée évaluer de façon indépendante lefficacité du système.

Selon New Scientist, lIA a un avenir prometteur dans la police, notamment dans les systèmes de prédiction de la criminalité. Un exemple est le système PredPol, application développée à l'Université de Santa Clara en Californie et qui tente de déterminer les points chauds de la criminalité. PredPol a été utilisé aux États-Unis et au Royaume-Uni, a rapporté New Scientist.

Source : New Scientist, Minority Report

Et vous ?

Quen pensez-vous ?

Pensez-vous que lIA est déjà prête pour des utilisations efficaces dans la prédiction des crimes ?

Voir aussi

Chine : le système de crédit social, comme une science-fiction dystopique, est en marche, et fait déjà des victimes

La police chinoise utilise le big data pour des arrestations préventives dans la région du Xinjiang, d'après l'association Human Rights Watch

Chine : la police se sert de la reconnaissance faciale pour arrêter un fugitif, la fiction Big Brother de 1984 est-elle devenue une réalité en 2018 ?

À Londres, la police teste une technologie de reconnaissance faciale pour retrouver des suspects : les populations entre approbation et condamnation

Espagne : la police s'appuie sur l'IA pour débusquer les fausses déclarations de vol, VeriPol dispose d'un taux de précision de 83 %

Répondre avec citation

Répondre avec citation

Partager