Le nouveau modèle d'IA de Facebook traduit directement 100 langues sans dépendre de l'anglais,

Il a été formé sur un ensemble de données de 7,5 milliards de paires de phrases

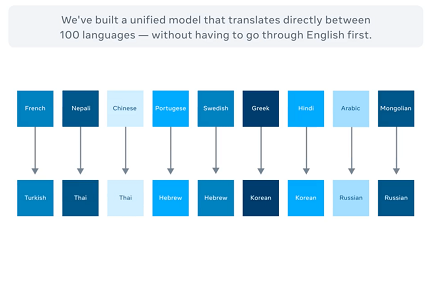

Facebook a développé une intelligence artificielle capable de traduire avec précision entre n'importe quelle paire de 100 langues sans devoir d'abord traduire vers l'anglais, comme le font de nombreux systèmes existants. Le modèle du réseau social surpasse ces systèmes de 10 points sur une échelle de 100 points utilisée par les universitaires pour évaluer automatiquement la qualité des traductions automatiques, selon Facebook. Baptisé M2M-100, le système n'est pour l'instant qu'un projet de recherche, mais pourrait à terme être utilisé pour traduire les messages des utilisateurs de Facebook, dont près des deux tiers utilisent une langue autre que l'anglais.

Les systèmes de traduction automatique classiques nécessitent la création de modèles d'intelligence artificielle distincts pour chaque langue et chaque tâche, mais, selon Facebook, cette approche n'est pas efficace sur son réseau social, où les gens publient du contenu dans plus de 160 langues sur des milliards de messages. Aussi, les systèmes multilingues avancés peuvent traiter plusieurs langues à la fois, mais compromettent la précision en s'appuyant sur des données en anglais pour combler l'écart entre la langue source et la langue cible.

Pour mieux servir sa communauté, Facebook a présenté lundi dernier le premier modèle de traduction automatique multilingue (MMT) qui peut traduire entre toute paire de 100 langues sans se baser sur des données en anglais. Le modèle a été élaboré en open source, selon un billet de blog publié par Angela Fan, assistante de recherche chez Facebook.

« Depuis des années, les chercheurs en intelligence artificielle travaillent à la construction d'un modèle universel unique qui peut comprendre toutes les langues à travers différentes tâches », a déclaré Fan dans le billet. « Un modèle unique qui prend en charge toutes les langues, tous les dialectes et toutes les modalités nous aidera à mieux servir plus de personnes, à tenir les traductions à jour et à créer de nouvelles expériences pour des milliards de personnes de manière égale. Ce travail nous rapproche de cet objectif ».

Un modèle formé à partir d'un ensemble de données de 7,5 milliards de paires de phrases dans 100 langues

Le système de Facebook a été formé sur la base d'un ensemble de données de 7,5 milliards de paires de phrases recueillies sur le Web dans 100 langues, bien que toutes les langues n'aient pas le même nombre de paires de phrases. « Ce qui m'intéressait vraiment, c'était de supprimer l'anglais en tant qu'intermédiaire. Dans le monde entier, il y a beaucoup de régions où l'on parle deux langues qui ne sont pas l'anglais », explique Angela Fan de Facebook AI, qui a dirigé le travail.

Le modèle a été formé en se concentrant sur les langues qui sont couramment traduites entre elles, en regroupant les langues dans 14 collections distinctes en fonction de la géographie et des similitudes culturelles. Cela a été fait pour assurer une traduction de haute qualité des connexions les plus couramment utilisées, et pour former le modèle de manière plus précise, daprès Fan. Cette approche favoriserait les habitants des pays dont les langues partagent ces caractéristiques et qui seraient plus susceptibles de bénéficier des traductions entre elles.

Par exemple, un groupe comprenait des langues courantes en Inde, telles que l'hindi, le bengali et le marathi. Toutes les paires de langues possibles au sein de chaque groupe ont ensuite été extraites. Les langues des différents groupes ont été reliées par un petit nombre de langues passerelles. Dans l'exemple du groupe des langues indiennes, l'hindi, le bengali et le tamoul ont servi de langues passerelles pour la famille des langues indo-aryennes.

L'équipe a ensuite exploité les données d'entraînement pour toutes les combinaisons de ces langues passerelles, ce qui lui a laissé un ensemble de données de 7,5 milliards de phrases parallèles correspondant à 2 200 directions de traduction, daprès le billet de Fan.

Pour les langues ne disposant pas de données de traduction de qualité, les chercheurs ont utilisé une méthode appelée rétro-traduction pour générer des traductions synthétiques qui peuvent compléter les données extraites. Cette combinaison de techniques a donné naissance au premier modèle de traduction automatique multilingue (MMT) qui peut traduire entre n'importe quelle paire de 100 langues sans s'appuyer sur des données en anglais, selon Facebook.

Daprès lassistante de recherche chez Facebook AI, pour certaines paires de langues, le nouveau système montre des améliorations significatives par rapport à la qualité de traduction existante. Par exemple, la traduction de l'espagnol vers le portugais est particulièrement performante, car l'espagnol est la deuxième langue maternelle la plus parlée au monde, ce qui signifie que les chercheurs ont eu accès à une grande quantité de données de formation. La traduction entre l'anglais et le biélorusse s'est également améliorée par rapport aux efforts existants, car l'IA apprend en traduisant le russe, qui présente des similitudes avec le biélorusse.

M2M-100 va traiter les 20 milliards de traductions effectuées chaque jour sur Facebook

« Lors de la traduction, par exemple, du chinois vers le français, la plupart des modèles multilingues centrés sur l'anglais s'entraînent sur le chinois vers l'anglais et l'anglais vers le français, car les données d'entraînement en anglais sont les plus largement disponibles », a déclaré Fan. « Notre modèle s'entraîne directement sur les données du chinois vers le français pour mieux préserver le sens ».

Selon Fan, l'un des plus grands obstacles à la construction d'un modèle de MMT de plusieurs langues à plusieurs est la conservation d'un grand nombre de paires de phrases de qualité pour des directions de traduction arbitraires n'impliquant pas l'anglais. Daprès le chercheur, il est beaucoup plus facile de trouver des traductions du chinois vers l'anglais et de l'anglais vers le français que, par exemple, du français vers le chinois. Un autre défi est que le volume de données nécessaires à la formation croît de « façon quadratique » avec le nombre de langues prises en charge.

Bien que le système ne soit pas encore utilisé sur le site de réseau social, Facebook prévoit de le mettre en uvre prochainement pour traiter les 20 milliards de traductions effectuées chaque jour lorsque les gens cliquent sur "Traduire" sur des messages écrits dans plus de 160 langues. Les travaux futurs porteront sur d'autres langues, a dit Fan, « en particulier pour les langues pour lesquelles nous n'avons pas beaucoup de données, comme les langues d'Asie du Sud-Est et d'Afrique ».

Selon NewScientist, les traductions produites par le modèle ont également été évaluées par les humains, qui ont estimé que le système était précis à environ 90 %. Le travail « s'éloigne des modèles centrés sur l'anglais et tente de construire des modèles multilingues plus diversifiés », a déclaré Sheila Castilho du ADAPT Centre de l'Université de Dublin City, en Irlande. « C'est rafraîchissant », a-t-elle ajouté.

Cependant, selon Castilho, les évaluations humaines n'ont porté que sur une petite fraction des exemples, ce qui rend difficile de savoir s'il s'agit d'un jugement précis sur les performances du modèle dIA. Elle s'inquiète également du fait que l'évaluation a été faite par des volontaires bilingues, plutôt que par des traducteurs professionnels. « Les non-professionnels n'ont pas de connaissances en matière de traduction et peuvent donc ne pas remarquer les différences subtiles qui rendent une traduction meilleure qu'une autre », dit-elle.

Son collègue du ADAPT centre, Andy Way, suggère que Facebook ne fait pas une comparaison équitable avec les systèmes de traduction de pointe existants. L'affirmation selon laquelle ils ont une si grande amélioration par rapport aux modèles centrés sur langlais est un peu vide, car la plupart du temps, les gens ne font plus cela », dit-il.

Source : Facebook

Et vous ?

Que pensez-vous du nouveau modèle dIA de Facebook ?

Que pensez-vous du doute émis par Sheila Castilho sur lévaluation de la performance de M2M-100 ?

Voir aussi :

Les solutions d'Intelligence Artificielle telles que l'intelligence artificielle conversationnelle ou encore l'analyse prédictive permettent de modifier les modèles commerciaux A/NZ

OpenAI a publié l'IA de génération de texte qu'il disait trop dangereuse pour être divulguée, mais le modèle n'est pas encore parfait

Amazon propose aux développeurs AutoGluon, une boîte à outils open source qui vient automatiser le deep learning, et les aider à intégrer l'IA dans leurs applications

Facebook annonce son framework de Machine Learning PyTorch 1.1, avec le compilateur JIT maintenant beaucoup plus mature

Répondre avec citation

Répondre avec citation

Partager