15 % des employés utilisent et transmettent à ChatGPT une grande quantité de données relatives à leurs employeurs,

et 6 % de ces données peuvent être considérées comme sensibles

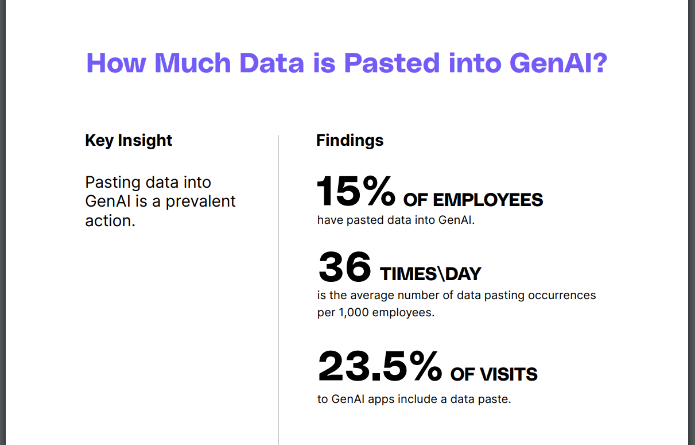

ChatGPT est devenu un élément essentiel de l'accomplissement du travail pour un certain nombre d'employés dans le monde, mais malgré cela, les données qu'il reçoit ne peuvent pas être considérées comme sûres. Un rapport récent a interrogé environ 100 000 employés, et il s'avère que 15 % d'entre eux utilisent régulièrement ChatGPT, lui transmettant ainsi une grande quantité de données relatives à leurs employeurs.

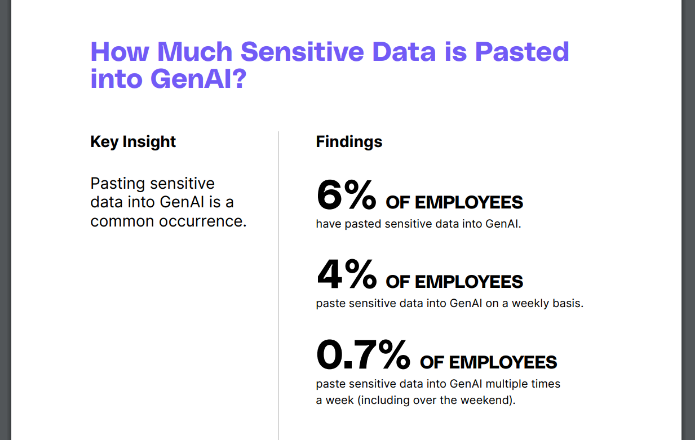

Ceci étant dit, il est important de noter que 6 % des données envoyées à ChatGPT peuvent être considérées comme sensibles. Cela peut être dangereux car c'est le genre de chose qui pourrait potentiellement ajouter ces données à la propre base de données de ChatGPT, la rendant ainsi beaucoup moins sûre qu'elle ne l'aurait été autrement.

43 % des données sensibles envoyées par inadvertance à des outils d'IA concernent des informations commerciales internes, 31 % d'entre elles consistent en un code source, et 12 % constituent le sous-ensemble extrêmement sensible des données personnelles identifiables, tous les éléments ayant été pris en compte.

Cela pourrait très bien conduire des concurrents ou même des acteurs malveillants à mettre la main sur ces données, et si cela devait se produire, les entreprises qui ont perdu ces données ne s'en rendraient même pas compte avant qu'il ne soit trop tard. 44 % des travailleurs utilisent actuellement ChatGPT au moins une fois au cours des trois derniers mois, et certains d'entre eux visitent ce site ou d'autres sites similaires plus de 50 fois par mois.

4 % de l'ensemble des employés collent activement des données sensibles dans ChatGPT chaque semaine, 50 % d'entre eux travaillant dans les départements de recherche et développement de leur employeur actuel. 23 % appartiennent à des services de vente et de marketing, et 14 % à des services qui gèrent les affaires financières.

Les employés doivent être informés des risques encourus, car cela peut augmenter considérablement la probabilité de cyberattaques. Cela peut également conduire à l'espionnage d'entreprise, ce qui peut avoir un effet d'entraînement sur l'ensemble de la communauté des affaires.

Source : Layer X

Et vous ?

Quel est votre avis sur le sujet ?

Trouvez-vous les résultats de ce rapport pertinents ?

Que pensez-vous des données recueillies par Layer X sur l'utilisation de ChatGPT par les employés ?

Pensez-vous que ces nouveaux chatbots d'IA sont des outils utiles ou plutôt des gadgets inutiles, voire nuisibles ?

Voir aussi :

Des employés partageraient des données professionnelles sensibles avec ChatGPT, ce qui suscite des craintes en matière de sécurité, ChatGPT pourrait mémoriser ces données et les divulguer plus tard

Chat GPT a atteint un million d'utilisateurs en un temps record, cinq jours seulement après sa création en novembre 2022, révolutionnant le gain de temps dans divers domaines

Les ingénieurs logiciels de Samsung ont divulgué des données sensibles en collant du code propriétaire dans ChatGPT, alors qu'ils recherchaient un correctif

OpenAI sur l'impact économique du GPT-4: « 80% des travailleurs auront au moins 10% de leurs tâches touchées », l'entreprise affirme que ses produits vont automatiser une vaste gamme de tâches pros

Répondre avec citation

Répondre avec citation

Partager